近日,MIT 科技评论跟踪报道了美国国防部高级研究计划局(DARPA)资助的“人工智能造假竞赛”,寻找识别 AI 造假的技术。

近日,MIT 科技评论跟踪报道了美国国防部高级研究计划局(DARPA)资助的“人工智能造假竞赛”,寻找识别 AI 造假的技术。

尽管 DARPA 自认:这可能是一场失败的战斗。

“AI 造假”是什么?

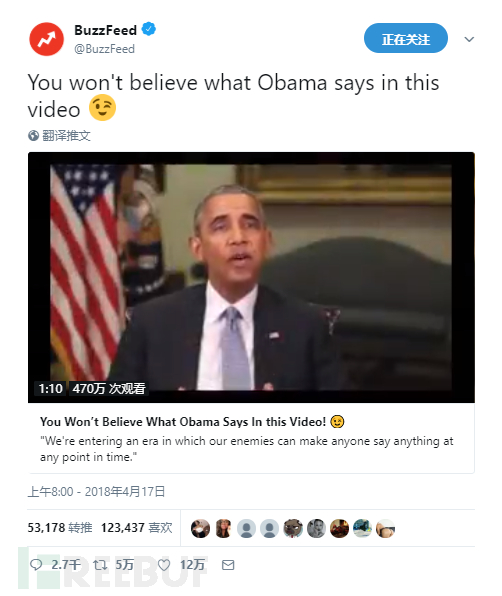

图中奥巴马用英语说:“川普总统完全就是个笨蛋。”这段无法上传的视频来自 Buzzfeed,无法上传的原因大概是:它是假的!

图中奥巴马用英语说:“川普总统完全就是个笨蛋。”这段无法上传的视频来自 Buzzfeed,无法上传的原因大概是:它是假的!

且不说前总统怒怼现总统制造出的火爆话题,这支视频在推特上狂揽 5 万转发和 12 万赞,它的制作工具也非常有意思,采用的是 Adobe AE 和 FakeApp。

且不说前总统怒怼现总统制造出的火爆话题,这支视频在推特上狂揽 5 万转发和 12 万赞,它的制作工具也非常有意思,采用的是 Adobe AE 和 FakeApp。

FakeApp 是一个用于生成假视频的“换脸”软件,使用者训练 AI 算法让破绽明显的换脸视频变得更加“真实”。于是,很多人开始利用这个技术把“小电影”主角的脸换成自己喜欢的明星。

未来的电影若是这样制作的,倒也无可厚非。那么,如果是新闻呢?如果是监控探头中的视频呢?AI 若被用来制造假图像、假视频并进行散布,普通群众上当受骗、失财是小,加剧社会冲突、威胁国家安全也未尝不可。

说起“AI 造假”技术的飞跃式发展,是在生成对抗网络(Generative Adversarial Networks,简称 GAN)出现之后。

2018 年《麻省理工科技评论》评选的“全球十大突破性技术”将 GAN 选入其中,评价道:

“它(GAN)给机器带来一种类似想象力的能力,因此可能让它们变得不再那么依赖人类,但也把它们变成了一种能力惊人的数字造假工具。”

《福布斯》也将 GAN 列入“过去三年最佳创新技术榜单”,与实用性增强现实、云计算、人工智能与深度学习应用等前沿技术齐名。

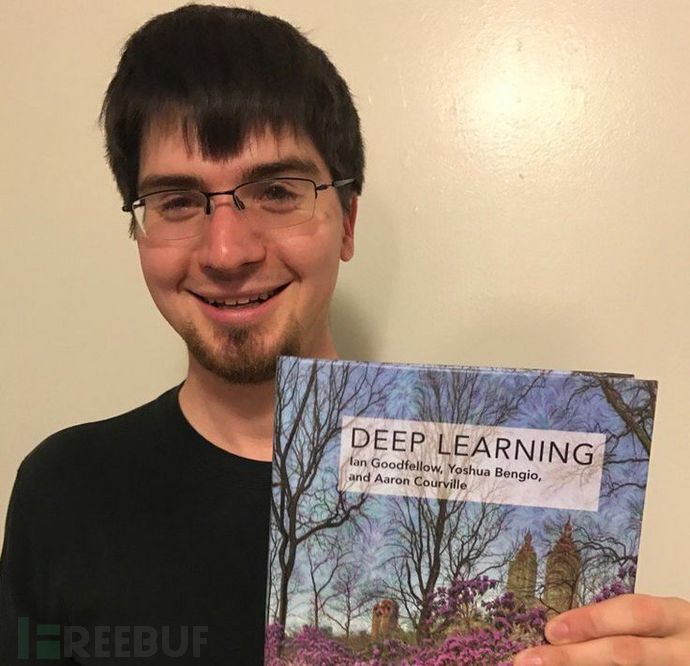

GAN 的发明者 Ian Goodfellow 现为谷歌大脑研究科学家、《深度学习》教科书作者之一。2014 年的一晚,他想到让两个神经网络互相对抗会产生怎样的效果......于是他提出了 GAN。

伟大的模仿大师过去可能是伟大的鉴定师。

伟大的模仿大师过去可能是伟大的鉴定师。

关于 GAN,我们可以简单理解为一个制造仿制品的名画仿造者和一个鉴定师。两者在互相博弈的过程中训练自己的技巧,让各自的技能得到提升。最终,仿造者会生成鉴定师无法判断的赝品。

如此一来,GAN 赋予机器更加强大的“分析能力”,同时也提升了机器的造假能力。

目前在 GAN 领域的研究已经有很多。2016 年 Ian Goodfellow 和谷歌大脑另一位大牛 Alexey Kurakin 在 GeekPwn(极棒)黑客大赛硅谷站现场演示了成功利用打印出的对抗样本图像欺骗视觉分类器,证实对抗样本能够产生现实危害。

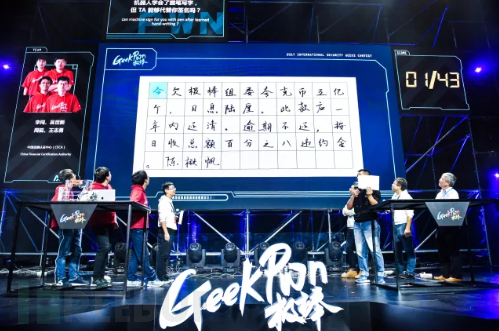

2017 年,GeekPwn 上海站选手、来自中国金融认证中心(CFCA)机器学习实验室成功利用 GAN 让 AI 模仿笔迹并成功骗过专业笔迹鉴定专家。

2017 年,GeekPwn 上海站选手、来自中国金融认证中心(CFCA)机器学习实验室成功利用 GAN 让 AI 模仿笔迹并成功骗过专业笔迹鉴定专家。

笔迹作为签名者的身份象征自古以来就存在,因为那时签名是可信的,大多数情况下不可伪造。但是现在机器掌握了这门模仿技艺,可以充当司法证据的笔迹鉴定遭到了前所未有的“灭门之灾”。

笔迹作为签名者的身份象征自古以来就存在,因为那时签名是可信的,大多数情况下不可伪造。但是现在机器掌握了这门模仿技艺,可以充当司法证据的笔迹鉴定遭到了前所未有的“灭门之灾”。

前文提到的 2018 年突然爆火的“小”视频换脸应用 DeepFake,同样采用了 GAN 技术。

GAN 的发展似乎已经超过了专家学者的预料,连假新闻都“搞不定”的人类又该如何面对危机四伏的假图、假视频、假笔迹呢?

CAAD2018 对抗样本攻防大赛

现在 DARPA 想要解决的这个问题,GeekPwn 同样看到了,而且早就开始了行动。

2018 年初,GeekPwn 宣布联合谷歌大脑顶级专家 Alexey Kurakin 和 Ian Goodfellow、美国加州大学伯克利分校 EECS 教授宋晓冬共同发起了“2018 对抗样本攻防赛”(Competition on Adversarial Attacks and Defenses 2018),简称 CAAD2018。

本届比赛聚焦针对图像分类器的攻防技术,设立了“定向对抗攻击”、“非定向对抗攻击”以及“对抗防御”三大项目,参赛者可以同时报名,既担任攻击者也可以扮演功能防御者的角色,分别提交程序。

- 非定向对抗攻击:此项比赛的目标是轻微修改原图像,使得未知分类器将修改后的图像错误分类。

- 定向对抗攻击:此项比赛的目标是轻微修改原图像,使得未知分类器将修改后的图像错误分类到指定的类。

- 对抗防御:此项比赛的目标是生成基于机器学习的分类器,对对抗样本有强的防御力,也即能够正确地把对抗样本进行分类。

为了让大家更好理解这个规则,我们举个例子说明一下:

- 非定向对抗攻击:你要让 AI 以为看到的苹果并不是苹果。

- 定向对抗攻击:你要让 AI 以为看到的苹果是香蕉。

- 对抗防御:无论是苹果还是香蕉,你要让 AI 不犯错。

参赛者需要提交程序来完成相应的任务。参赛过程中有任何疑问,请发送邮件至 caad@geekpwn.org。

得分评估

【阶段一】首先使用基准攻击和防御进行预评估,在三个项目中各挑选前 40 名(如果第40名处有比分非常接近的情况,比赛组委将再挑出最多 10 名);

【阶段二】三项的前 40 名会让各个攻击对防御进行单循环对抗,计算总的分数并决出名次。

评分公式

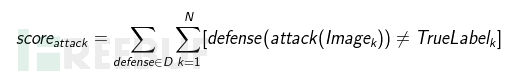

非定向对抗攻击

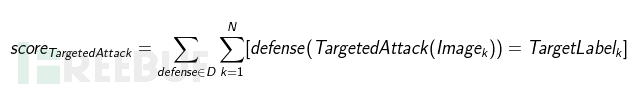

定向对抗攻击

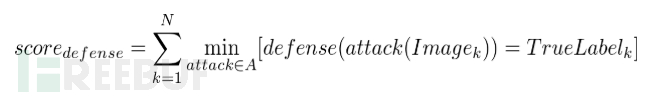

对抗防御

关于得分详细说明,欢迎前往

获胜选手奖金

本次比赛三个项目各取前五名颁奖:

第一名-人民币 100,000 元

第二名-人民币 55,000 元

第三名-人民币 35,000 元

第四、五名-人民币 6,000 元

获胜队伍需要提交技术说明文档,根据文档最高得分者可另得技术奖人民币 6,000 元。

参赛时间

报名截止时间为 2018 年 8 月 31 日。

最后放一个彩蛋:

CAAD CTF 邀请赛将在 8 月于美国拉斯维加斯 GeekPwn 大赛现场举行。主办方将邀请全球顶级 AI 研究团队,通过 CTF 夺旗赛的形式结合 GAN 进行攻防对战。人工智能攻防与网络安全的跨界,将会带来哪些惊喜呢?

关注并置顶 GeekPwn 微信公众号,带你第一时间触及未来!